Wenn du dich in letzter Zeit für KI‑Video interessiert hast, stehen die Chancen gut, dass du schon Leute über Seedance 2.0 sprechen gesehen hast. Aber die meisten Artikel bleiben an derselben Stelle stehen: Sie sagen, das Tool sei leistungsstark, filmisch und spannend – und überlassen dir dann selbst herauszufinden, wie der eigentliche Workflow aussieht.

Dieser Artikel wählt einen praktischeren Weg. Statt das Modell wie ein Buzzword zu behandeln, geht es darum, wie man ByteDance Seedance 2.0 auf SeaImagine AI so nutzt, dass es einfach, nützlich und zuschauerorientiert ist. Das Ziel ist nicht, den kompliziertesten Clip überhaupt zu erzeugen. Das Ziel ist, kurze Videos zu erstellen, die sauberer aussehen, bewusster wirken und dir bessere Ergebnisse liefern, ohne deine Credits zu verbrennen.

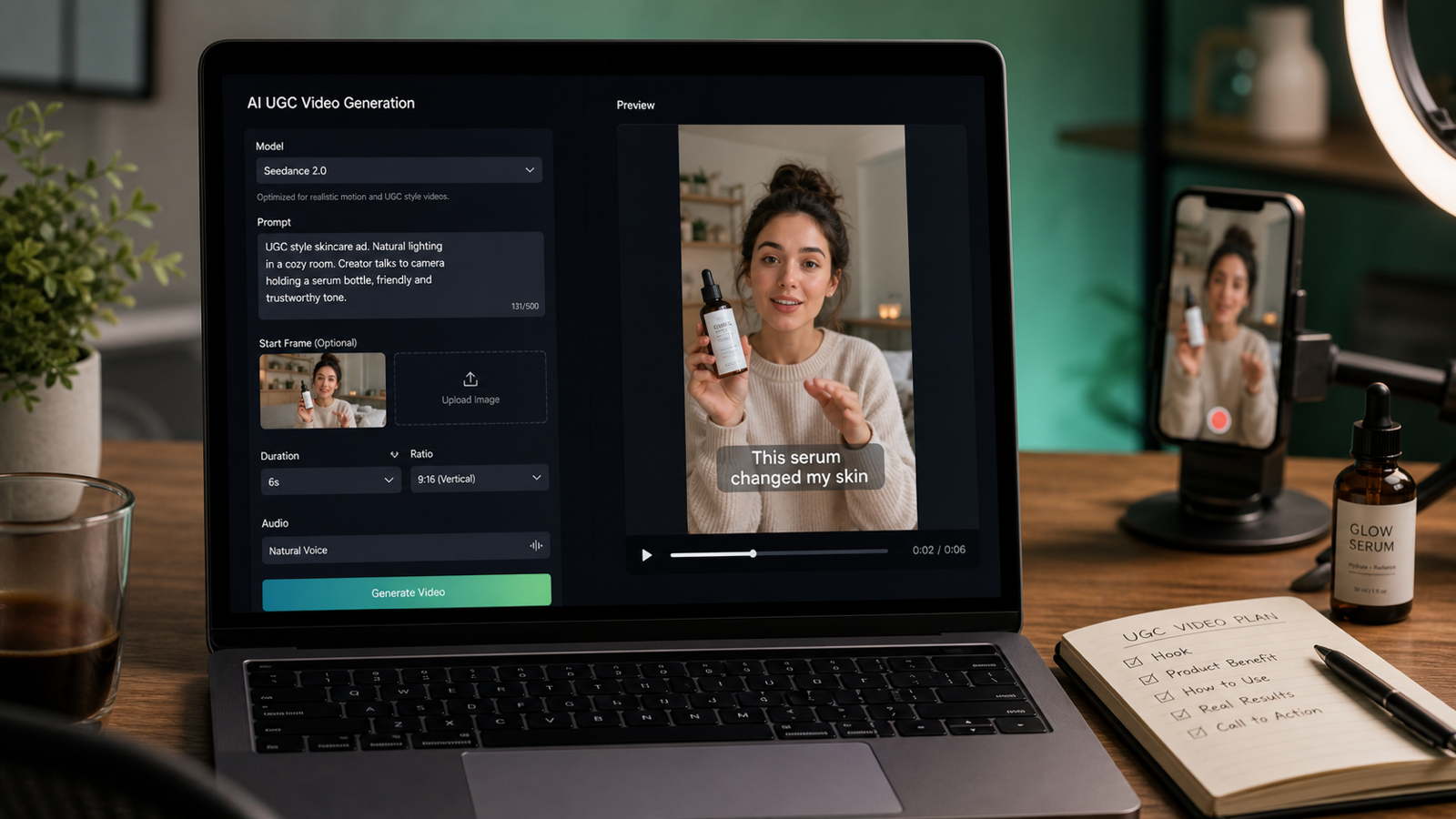

SeaImagine AI bietet dir einen direkten Zugang zum Modell über die Seedance 2.0‑Zugangsseite. Von dort aus ist der Workflow auch für Einsteiger klar genug: Modell auswählen, ein Startbild hochladen, falls du eines hast, optional ein Endframe hinzufügen, den Prompt eingeben, entscheiden, ob Audio aktiviert werden soll, dann Auflösung, Dauer und Seitenverhältnis festlegen, bevor du generierst. So lässt sich das Modell viel leichter durch Praxis statt durch Theorie lernen.

Warum Seedance 2.0 das Lernen wert ist

Die Stärke von Seedance 2.0 AI liegt nicht nur darin, aus einem Prompt Bewegung zu erzeugen. Interessant wird es durch die Art, wie mehrere Eingaben kombiniert und in einen kohärenteren Short‑Form‑Video‑Workflow überführt werden. Es ist für Text‑, Bild‑, Audio‑ und Video‑Input ausgelegt, was sowohl Experimente als auch stärker geführte Generierung begünstigt.

Für Alltags‑Creator ist das wichtig, weil kurze KI‑Clips in der Regel nicht an technischer Neuheit gemessen werden. Sie werden danach bewertet, ob Menschen weiter zusehen. Ein Fünf‑Sekunden‑Clip mit klarem Motiv, natürlicher Bewegung und starker Stimmung funktioniert meistens besser als ein chaotischer Prompt voller großer filmischer Sprache.

Deshalb ergibt ein zuschauerorientierter Ansatz mehr Sinn als ein modellorientierter. Wenn du Seedance 2.0‑Videogenerierung nutzt, ist die klügste Haltung, darüber nachzudenken, was der Zuschauer in der ersten Sekunde sieht, was sich im Clip verändert und warum sich die Bewegung sehenswert anfühlt.

Erste Schritte mit SeaImagine AI

Am einfachsten ist der Einstieg, wenn du SeaImagine AI als geführten Kreativbereich und nicht als leeres Labor betrachtest. Auf der Seedance 2.0‑AI‑Videoseite siehst du die wichtigsten Regler direkt auf den ersten Blick, was den Prozess weniger einschüchternd macht.

Ein anfängerfreundlicher Durchlauf sieht in der Regel so aus:

- Wähle das Modell aus.

- Lade ein Startframe hoch, wenn du bereits ein Bild hast.

- Füge nur dann ein Endframe hinzu, wenn du eine kontrolliertere visuelle Entwicklung möchtest.

- Schreibe einen Prompt, der eine Szene klar beschreibt.

- Entscheide, ob Audio aktiviert werden soll.

- Lege Auflösung, Cliplänge und Seitenverhältnis fest.

- Generiere lieber mehrere Varianten, statt alles auf ein einziges Ergebnis zu setzen.

Dieser Workflow ist nützlich, weil er zu Zurückhaltung anhält. Viele steigen in KI‑Video ein und erwarten, dass ein einziger Prompt beim ersten Versuch einen polierten Werbespot, einen Kurzfilm oder eine animierte Szene erzeugt. In der Praxis kommen bessere Ergebnisse meist zustande, wenn man mit einer klaren, einfachen Idee startet und dann kleine Details anpasst.

Die beste Strategie für den ersten Prompt

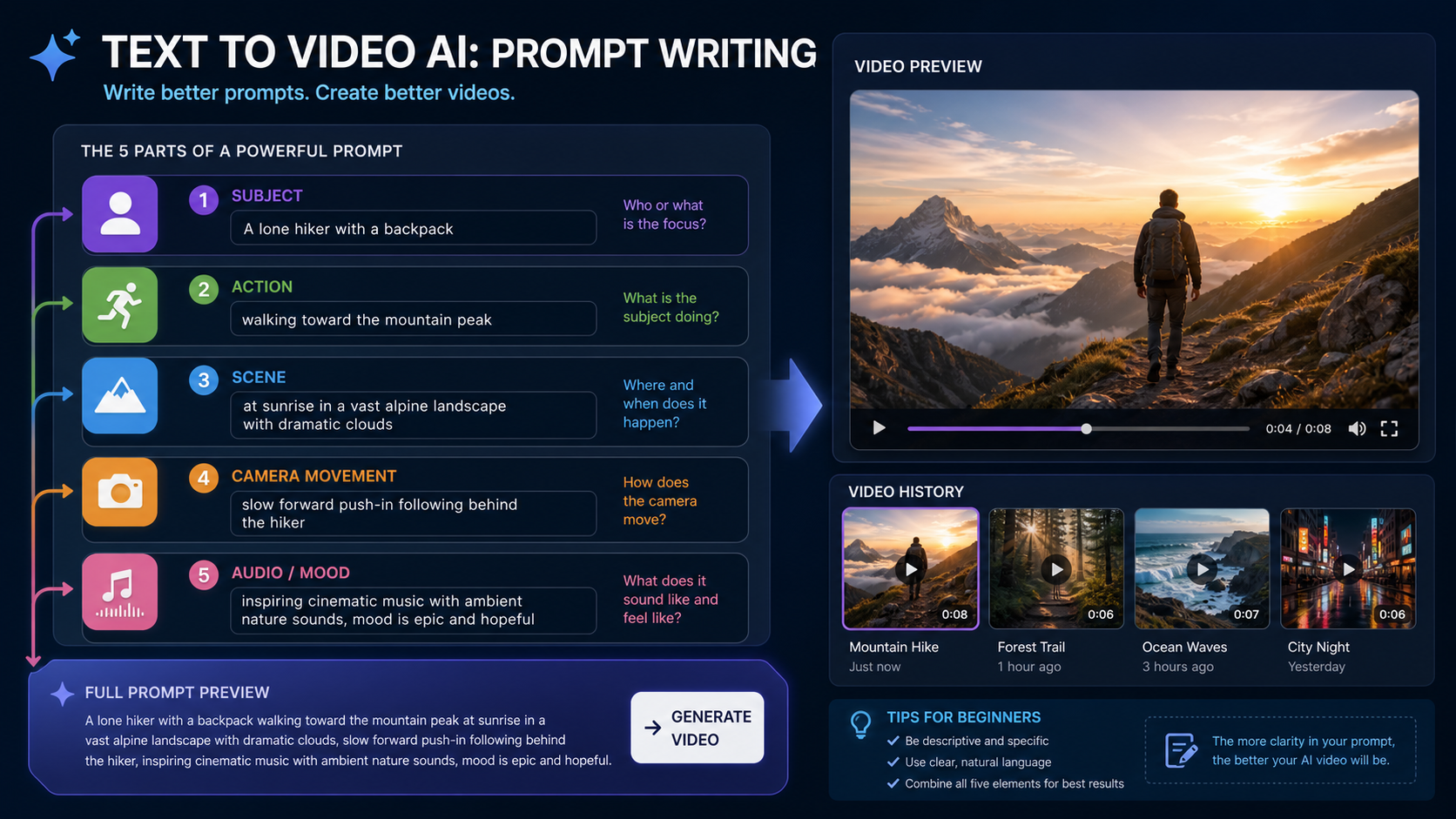

Wenn Nutzer mit AI Seedance 2.0 kämpfen, liegt es oft daran, dass ihr erster Prompt zu viel auf einmal will. Zuverlässiger ist ein Ansatz, der den Prompt nur um fünf Dinge herum aufbaut: Motiv, Setting, Aktion, Kamera und Stimmung.

Anstatt also einen riesigen Absatz zu schreiben, versuche etwa diese Struktur:

- Motiv: eine junge Frau in einem gelben Regenmantel

- Setting: steht nachts auf einer ruhigen Stadtstraße

- Aktion: sie blickt nach oben, während sich Neonreflexionen auf dem nassen Asphalt kräuseln

- Kamera: langsamer Push‑In

- Stimmung/Stil: filmisch, leichter Regen, kühles blaues Licht

Damit bekommt das Modell etwas Visuelles und filmisch Umsetzbares. Für einen Seedance 2.0‑AI‑Videoworkflow ist es deutlich einfacher, einen starken Kurzclip zu liefern, wenn die Aktion lesbar ist und die Szene nicht überladen wird.

Wenn du Audio testen willst, tu das bewusst. Aktiviere es nicht nur, weil es die Option gibt. Frag dich, ob Ton den Clip wirklich verbessert. Wenn du eine stimmungsvolle, filmische Szene anstrebst, können Regengeräusche oder urbane Ambient‑Sounds helfen. Wenn du einen Produkt‑Teaser für Social Media planst, sind stille Visuals vielleicht klarer.

Wie du bessere Ergebnisse bekommst, ohne Credits zu verschwenden

Viel Verbesserung kommt eher von Prompt‑Disziplin als von versteckten Tricks. Die nützlichsten Gewohnheiten sind simpel.

Beschreibe eine Einstellung, keine ganze Geschichte. Seedance arbeitet besser, wenn es einen Moment inszenieren soll, statt eine ganze Handlung zusammenzufassen.

Halte die Bewegung glaubwürdig. Eine Person, die sich dreht, geht, über die Schulter blickt oder mit einem klaren Objekt interagiert, funktioniert meist besser als mehrere schnelle Aktionen.

Nutze Kamerabewegung nur, wenn sie etwas beiträgt. Anfänger packen oft Begriffe wie Luftaufnahme, dramatischer Zoom, Orbit‑Kamera, Handkamera und Zeitlupe in einen Prompt. Das erzeugt meist Chaos, keine Eleganz.

Generiere Varianten, bevor du alles umschreibst. Wenn die Szene fast passt, ändere jeweils nur ein Element. Justiere Aktion, Bildausschnitt oder Stimmung und starte dann neu. Das nutzt deine Credits besser, als den Prompt jedes Mal komplett zu ersetzen.

Setze Start‑ und Endframes mit Absicht ein. Das Startframe ist besonders hilfreich, wenn du bereits ein starkes Bild hast und möchtest, dass das Modell die visuelle Identität enger beibehält. Ein Endframe hilft, wenn du ein klareres Ziel für die Bewegung brauchst.

Wann Seedance 2.0 sinnvoll ist – und wann nicht

Einer der hilfreichsten Beiträge eines Tutorials ist, klarzumachen, wann man das vorgestellte Modell nicht zwanghaft auf jede Aufgabe anwenden sollte.

Nutze den Seedance 2.0‑Zugang auf SeaImagine AI, wenn du ausdrucksstarke Kurzclips, stärkere prompt‑gesteuerte Bewegung oder einen Workflow möchtest, der Audio‑ und Bildführung einbeziehen kann.

Wenn du jedoch bereits ein poliertes Standbild hast und vor allem stabile Animation willst, ist ein Image‑to‑Video‑Workflow vielleicht einfacher. Wenn du einfach schnelle Konzeptclips aus einem Textprompt brauchst, fühlt sich ein breiteres Text‑to‑Video‑Tool eventuell schneller an. Mit anderen Worten: Seedance 2.0 ist stark, aber nicht die Lösung für jede Videoaufgabe.

Das ist für Leser sogar eine gute Nachricht. Du musst nicht ein einziges Tool zu allem zwingen. Du kannst das Modell dort nutzen, wo es glänzt, und den Workflow wechseln, wenn sich das Projekt ändert.

Häufige Fehler, die du vermeiden solltest

Der größte Fehler sind Prompts, die für einen kurzen Clip zu ambitioniert sind. Wenn deine Dauer nur ein paar Sekunden beträgt, sollte die Bewegung fokussiert bleiben.

Ein weiteres häufiges Problem ist, sich auf filmische Schlagwörter zu verlassen, ohne die eigentliche Szene zu beschreiben. Wörter wie episch, atemberaubend oder Meisterwerk geben dem Modell nicht genug echte visuelle Richtung.

Ein dritter Fehler ist, das Zielmedium zu ignorieren. Wenn der Clip für Mobile gedacht ist, wähle das Seitenverhältnis entsprechend. Wenn es nur ein schneller Teaser sein soll, halte die Dauer kurz. Gutes KI‑Video hängt nicht nur von der Generierungsqualität ab, sondern auch von der Format‑Passung.

Und schließlich: Geh nicht davon aus, dass das erste Ergebnis das fertige Ergebnis ist. Der echte Workflow lautet meist: Prompt, generieren, prüfen, verfeinern, dann neu starten.

Ein einfacher, zuschauerorientierter Workflow zum Wiederholen

Hier ist die einfachste wiederholbare Methode, um Seedance 2.0‑Video auf SeaImagine AI sinnvoll zu nutzen.

Starte mit dem Zweck des Clips. Geht es um Stimmung, Storytelling, Promotion oder das Testen einer Idee?

Schreibe dann den einfachsten Prompt, der diesen Zweck klar ausdrückt. Füge nur eine Hauptaktion hinzu. Wähle Audio nur, wenn es das Ergebnis unterstützt. Passe das Seitenverhältnis an die Plattform an. Generiere ein paar Versionen. Behalte die beste. Ändere dann in der nächsten Runde jeweils nur eine Variable.

Dieser Prozess klingt schlicht, ist aber genau das, was KI‑Video kontrollierter und weniger zufällig wirken lässt.

Abschließende Gedanken

ByteDance Seedance 2.0 ist interessant, weil es Creatorn einen flexibleren Einstieg in KI‑Video bietet, ohne einen komplett technischen Workflow zu verlangen. Auf SeaImagine AI macht die Oberfläche diesen Prozess zugänglicher, besonders für Menschen, die schnell Prompts, Bilder und Short‑Form‑Ideen testen wollen.

Am sinnvollsten ist es, nicht dem kompliziertesten Ergebnis hinterherzujagen. Stattdessen geht es darum, kurze Clips mit klarer Absicht, einfacher visueller Sprache und zuschauerorientierter Bewegung zu bauen. Dort wirkt das Modell am praktikabelsten.

Wenn du dort beginnst, wirst du deutlich mehr aus dem Tool herausholen.

Empfohlene Tools

- SeaImagine Text to Video für schnellere, rein promptbasierte Videoexperimente.

- SeaImagine Image to Video, wenn du ein Standbild mit starker visueller Kontinuität animieren möchtest.

- SeaImagine AI Hug Video Generator für social‑freundliche Charakter‑ und Fotoanimation.

- SeaImagine AI Baby Dance Generator für verspielte Short‑Form‑Videoideen.

- SeaImagine AI Image Generator zum Erstellen von Ausgangsbildern, bevor du in Video übergehst.

Verwandter Artikel

- SeaImagine AI Text-to-Video Guide: How to Choose Models and Create Better Clips

- The 2026 Image-to-Video Guide for Sea Imagine AI: Best Models & Prompts

- How to Use Sea Imagine AI’s Image Generator: A Beginner-Friendly Tutorial

- How to Turn Ordinary Photos into Cartoon and Anime-Style Art with SeaImagine AI

Das lesen andere ebenfalls

- How to Use HeyDream AI’s Text-to-Video Generator: Model Comparison, Prompting Tips, and Workflows

- Seedance 2.0 vs Seedance 1.0: What’s Better for AI Video

- The Release of Seedance 2.0: What Dropped, What’s New, and What Creators Should Do Next

- Seedance 2.0 Video Generation Guide: How to Create Better AI Videos

- Seedance 2.0 Video Generation Guide (Tutorial + Prompts)

- How to Use Seedance 2.0 for Anime Clips: Prompt Examples and Scene Ideas

- Seedance 2.0 Access and Pricing Guide: Where It Stands Now and What AIFacefy Adds

- Higgsfield AI vs AIFacefy AI for Seedance 2.0: Which Creator Workflow Wins?