Se você tem se interessado por vídeo com IA ultimamente, é bem provável que tenha visto pessoas falando sobre Seedance 2.0. Mas a maioria dos textos para por aí: dizem que é poderoso, cinematográfico e empolgante, e depois deixam você descobrir o fluxo de trabalho sozinho.

Este artigo segue um caminho mais prático. Em vez de tratar o modelo como um mero termo da moda, ele mostra como usar o ByteDance Seedance 2.0 no SeaImagine AI de um jeito simples, útil e focado no espectador. O objetivo não é gerar o clipe mais complicado possível. O objetivo é criar vídeos curtos que pareçam mais limpos, mais intencionais e que deem um resultado melhor sem consumir todos os seus créditos.

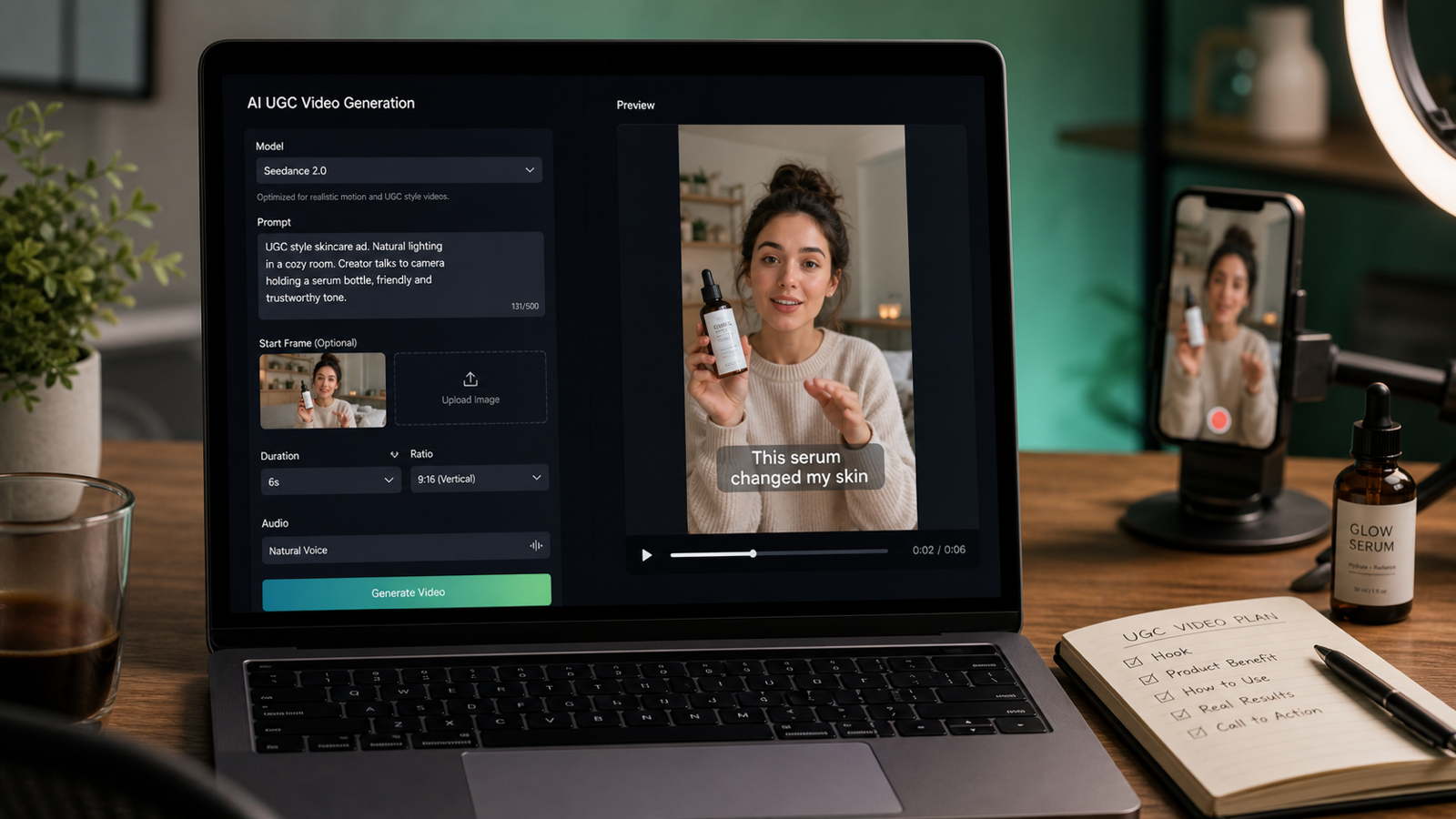

O SeaImagine AI oferece uma forma direta de testar o modelo por meio da página de acesso ao Seedance 2.0. A partir daí, o fluxo é claro o suficiente para iniciantes: escolher o modelo, enviar uma imagem inicial se quiser, adicionar um frame final opcional, digitar o prompt, decidir se o áudio deve ser ativado e, então, definir resolução, duração e proporção antes de gerar. Isso torna muito mais fácil aprender o modelo na prática em vez de só na teoria.

Por que vale a pena aprender o Seedance 2.0

O apelo do Seedance 2.0 AI não é apenas gerar movimento a partir de um prompt. O que o torna interessante é a forma como combina múltiplas entradas e tenta transformá-las em um fluxo de trabalho de vídeo de curta duração mais coerente. Ele é projetado para entrada de texto, imagem, áudio e vídeo, o que significa que serve tanto para experimentação quanto para geração mais guiada.

Para criadores do dia a dia, isso importa porque clipes curtos de IA normalmente não são avaliados pela novidade técnica. Eles são avaliados pelo quanto as pessoas continuam assistindo. Um clipe de cinco segundos com um sujeito claro, movimento natural e um clima forte geralmente funciona melhor do que um prompt confuso cheio de linguagem cinematográfica grandiosa.

É por isso que uma abordagem focada no espectador faz mais sentido do que uma focada no modelo. Se você está usando a geração de vídeo Seedance 2.0, a mentalidade mais inteligente é pensar no que o espectador vê no primeiro segundo, no que muda ao longo do clipe e por que o movimento vale a pena ser visto.

Começando no SeaImagine AI

A maneira mais fácil de começar é tratar o SeaImagine AI como um espaço de criação guiada, não como um laboratório em branco. Na página de vídeo Seedance 2.0 AI, você vê os principais controles logo de cara, o que torna o processo menos intimidador.

Um uso amigável para iniciantes costuma ser assim:

- Selecione o modelo.

- Envie um frame inicial se você já tiver uma imagem.

- Adicione um frame final apenas se quiser uma progressão visual mais controlada.

- Escreva um prompt que descreva claramente uma cena.

- Escolha se o áudio deve ser ativado.

- Defina resolução, duração do clipe e proporção.

- Gere algumas variações em vez de apostar em um único resultado.

Esse fluxo de trabalho é útil porque incentiva a moderação. Muita gente entra em vídeo com IA esperando que um único prompt crie um anúncio polido, um mini-filme ou uma cena animada logo na primeira tentativa. Na prática, resultados melhores normalmente vêm de começar com uma ideia limpa e depois ajustar detalhes pequenos.

A melhor estratégia de primeiro prompt

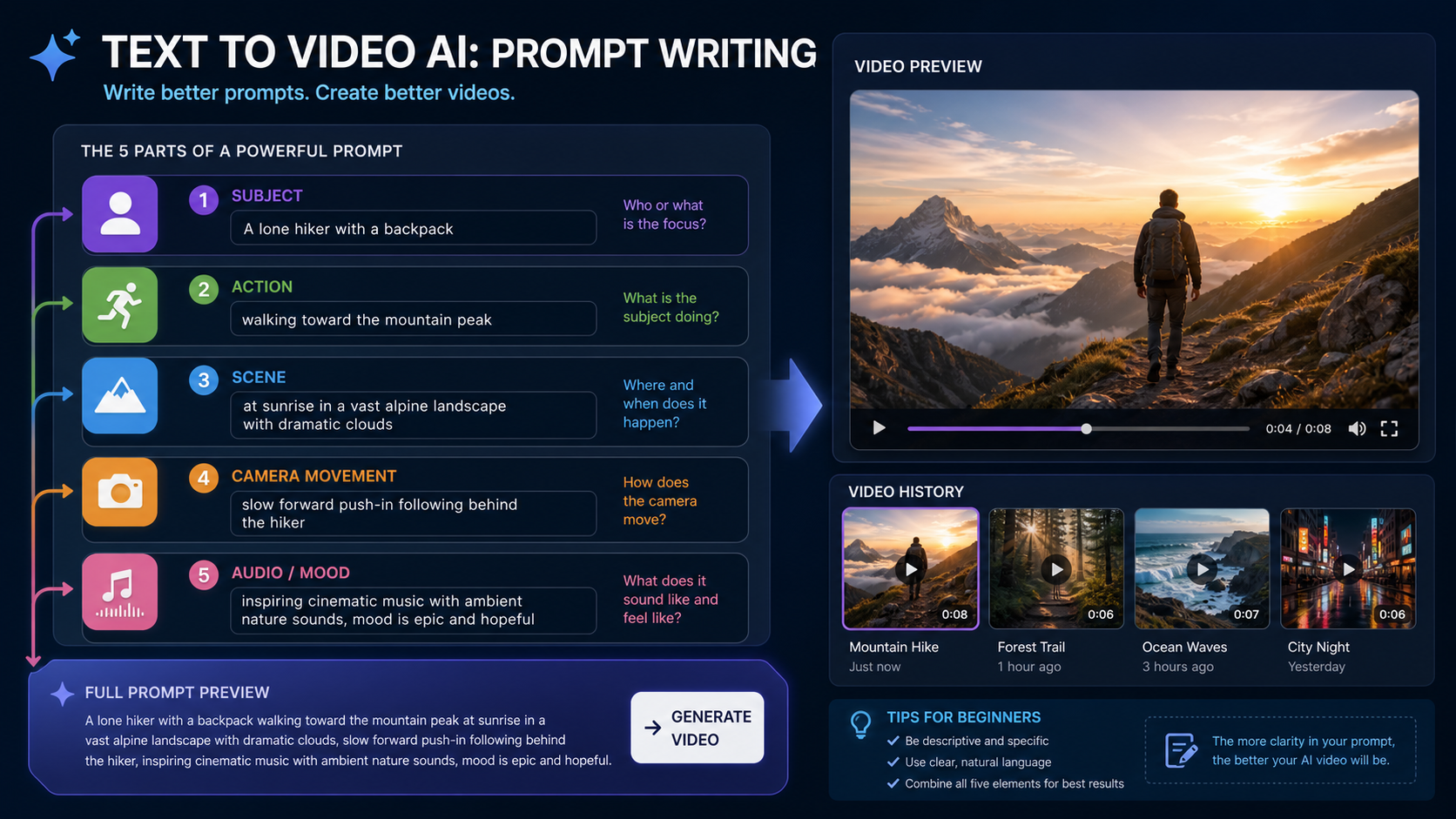

Quando as pessoas têm dificuldade com o AI Seedance 2.0, muitas vezes é porque o primeiro prompt tenta fazer demais. Uma abordagem mais confiável é construir o prompt em torno de apenas cinco elementos: sujeito, cenário, ação, câmera e clima/estilo.

Por exemplo, em vez de escrever um parágrafo gigante, experimente algo nesta estrutura:

- sujeito: uma jovem de capa de chuva amarela

- cenário: em pé em uma rua silenciosa da cidade à noite

- ação: ela olha para cima enquanto reflexos de neon ondulam pelo asfalto molhado

- câmera: aproximação lenta (slow push-in)

- clima/estilo: cinematográfico, chuva suave, iluminação azul fria

Isso dá ao modelo algo visual e “filmável”. É muito mais fácil para um fluxo de trabalho de vídeo Seedance 2.0 AI entregar um clipe curto forte quando a ação é legível e a cena não está sobrecarregada.

Se quiser testar áudio, faça isso de forma deliberada. Não ative só porque a opção existe. Pergunte-se se o som realmente melhora o clipe. Se o objetivo é um fragmento cinematográfico e atmosférico, som ambiente de chuva ou da cidade pode ajudar. Se o objetivo é um teaser de produto para redes sociais, visuais silenciosos podem ficar mais limpos.

Como obter resultados melhores sem desperdiçar créditos

Boa parte da melhoria vem da disciplina de prompt, não de truques secretos. Os hábitos mais úteis são simples.

Descreva um plano, não a história inteira. O Seedance funciona melhor quando é solicitado a encenar um momento do que a resumir todo um enredo.

Mantenha o movimento crível. Um sujeito virando, caminhando, olhando por cima do ombro ou interagindo com um único objeto claro costuma funcionar melhor do que múltiplas ações rápidas.

Use movimento de câmera apenas quando ele acrescentar algo. Iniciantes costumam empilhar frases como tomada aérea, zoom dramático, câmera em órbita, movimento de câmera na mão e câmera lenta em um único prompt. Isso geralmente gera ruído, não elegância.

Gere variações antes de reescrever tudo. Se a cena está quase certa, mude um elemento por vez. Ajuste a ação, o enquadramento ou o clima e rode novamente. Isso aproveita melhor os créditos do que substituir o prompt inteiro a cada rodada.

Use frames inicial e final com intenção. O frame inicial é especialmente útil quando você já tem uma imagem forte e quer que o modelo preserve melhor a identidade visual. Um frame final pode ajudar quando você quer um destino mais claro para o movimento.

Quando usar o Seedance 2.0 e quando não usar

Uma das coisas mais úteis que um tutorial pode fazer é dizer ao leitor quando não forçar o modelo apresentado em toda tarefa.

Use o acesso Seedance 2.0 no SeaImagine AI quando quiser clipes curtos expressivos, movimento mais forte guiado por prompt ou um fluxo de trabalho que possa incorporar áudio e orientação por imagem.

Mas se você já tem uma imagem estática polida e quer principalmente uma animação estável, um fluxo de image-to-video pode ser mais simples. Se só quiser clipes de conceito rápidos a partir de texto, uma ferramenta de text-to-video mais ampla pode parecer mais ágil. Em outras palavras, o Seedance 2.0 é forte, mas não é a resposta para todo tipo de trabalho em vídeo.

Isso na verdade é uma boa notícia. Significa que você não precisa forçar uma única ferramenta a fazer tudo. Você pode usar o modelo onde ele brilha e mudar de fluxo de trabalho quando o projeto exigir.

Erros comuns a evitar

O maior erro é escrever prompts ambiciosos demais para um clipe curto. Se a duração tem apenas alguns segundos, o movimento precisa permanecer focado.

Outro problema comum é depender de palavras-chave cinematográficas sem descrever a cena de fato. Palavras como épico, impressionante ou obra-prima não dão ao modelo direção visual suficiente.

Um terceiro erro é ignorar a plataforma de destino. Se o clipe é para celular, escolha a proporção adequada. Se é para um teaser rápido, mantenha a duração enxuta. Bom vídeo com IA não é apenas qualidade de geração. É também adequação de formato.

Por fim, não presuma que o primeiro resultado é o resultado final. O fluxo de trabalho real costuma ser: prompt, gerar, revisar, refinar e rodar de novo.

Um fluxo simples, focado no espectador, que você pode repetir

Aqui está o método repetível mais simples para usar bem o vídeo Seedance 2.0 no SeaImagine AI.

Comece pelo propósito do clipe. É para clima, narrativa, promoção ou testar uma ideia?

Depois escreva o prompt mais simples que expresse esse propósito com clareza. Adicione apenas uma ação principal. Escolha áudio só se ele ajudar no resultado. Combine a proporção com a plataforma. Gere algumas versões. Guarde a melhor. Em seguida, mude uma variável por vez na próxima rodada.

Esse processo pode soar básico, mas é exatamente o que faz o vídeo com IA parecer mais controlado e menos aleatório.

Considerações finais

O ByteDance Seedance 2.0 é interessante porque oferece aos criadores um caminho mais flexível para vídeo com IA sem exigir um fluxo de trabalho totalmente técnico. No SeaImagine AI, a interface torna esse processo mais acessível, especialmente para quem quer testar prompts, imagens e ideias de formato curto rapidamente.

A forma mais útil de abordá-lo não é correr atrás do resultado mais complicado. É construir clipes curtos com intenção clara, linguagem visual simples e movimento pensado primeiro para o espectador. É aí que o modelo se mostra mais prático.

Se você começar por aí, vai tirar muito mais proveito da ferramenta.

Ferramentas recomendadas

- SeaImagine Text to Video para experimentos mais rápidos de vídeo usando apenas prompt.

- SeaImagine Image to Video quando quiser animar uma imagem estática com maior continuidade visual.

- SeaImagine AI Hug Video Generator para animação de personagens e fotos em formato curto, amigável às redes sociais.

- SeaImagine AI Baby Dance Generator para ideias divertidas de vídeos curtos.

- SeaImagine AI Image Generator para criar imagens de origem antes de passar para vídeo.

Artigo relacionado

- SeaImagine AI Text-to-Video Guide: How to Choose Models and Create Better Clips

- The 2026 Image-to-Video Guide for Sea Imagine AI: Best Models & Prompts

- How to Use Sea Imagine AI’s Image Generator: A Beginner-Friendly Tutorial

- How to Turn Ordinary Photos into Cartoon and Anime-Style Art with SeaImagine AI

As pessoas também leem

- How to Use HeyDream AI’s Text-to-Video Generator: Model Comparison, Prompting Tips, and Workflows

- Seedance 2.0 vs Seedance 1.0: What’s Better for AI Video

- The Release of Seedance 2.0: What Dropped, What’s New, and What Creators Should Do Next

- Seedance 2.0 Video Generation Guide: How to Create Better AI Videos

- Seedance 2.0 Video Generation Guide (Tutorial + Prompts)

- How to Use Seedance 2.0 for Anime Clips: Prompt Examples and Scene Ideas

- Seedance 2.0 Access and Pricing Guide: Where It Stands Now and What AIFacefy Adds

- Higgsfield AI vs AIFacefy AI for Seedance 2.0: Which Creator Workflow Wins?